Unternehmenswissen nutzbar machen – ohne Datenroulette

Damit aus Dokumenten, Richtlinien und Erfahrungswissen endlich verlässliche Antworten werden: sicher, strukturiert und im Arbeitsalltag wirklich nutzbar.

In vielen Unternehmen ist Wissen vorhanden, aber nicht wirksam verfügbar:

Es steckt in Ordnern, Postfächern, Einzellösungen oder in den Köpfen einzelner Mitarbeitender. Wir helfen dabei, daraus ein sicheres, praxistaugliches Wissenssystem mit LLMs und Chatbots zu machen, das schneller Antworten liefert, Suchaufwand reduziert und Informationen belastbar verfügbar macht.

Problemstellung und Zielszenario beim Kunden

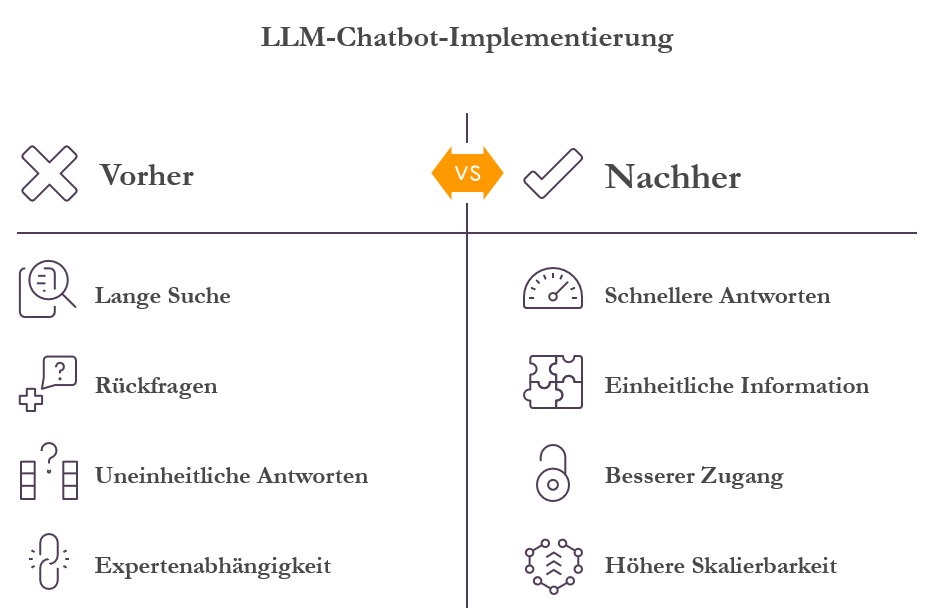

Unternehmenswissen ist heute meist nicht zu knapp, sondern zu verstreut. Mitarbeitende suchen in Dateien, Wikis, SharePoints, E-Mails, Prozessdokumenten oder fragen Kolleginnen und Kollegen direkt. Das kostet Zeit, unterbricht Abläufe und führt dazu, dass unterschiedliche Personen auf dieselbe Frage unterschiedliche Antworten geben. Gerade bei Richtlinien, internen Prozessen, Standards, Vertragsvorlagen, IT-Dokumentationen oder Einkaufsvorgaben entsteht so ein unnötiges Risiko: Entscheidungen basieren nicht immer auf dem aktuellsten oder freigegebenen Wissensstand.

Mit dem Einsatz von LLMs wächst gleichzeitig die Erwartung, Informationen schneller und einfacher nutzbar zu machen. Doch genau hier liegt in vielen Unternehmen die Hürde: Ein Chatbot ist schnell ausprobiert, aber noch lange kein verlässliches Wissenssystem. Ohne saubere Quellenbasis, klare Zugriffslogik, Governance und Qualitätssicherung entsteht schnell das, was viele vermeiden wollen: unklare Antworten, fehlende Nachvollziehbarkeit und Unsicherheit bei sensiblen Inhalten.

Das Zielszenario ist deshalb nicht einfach „ein Chatbot“, sondern eine Lösung, die im Alltag tatsächlich funktioniert. Mitarbeitende erhalten schneller fundierte Antworten auf interne Fragen, finden relevante Dokumente ohne langes Suchen, greifen auf einheitliche und freigegebene Informationen zu und können sich darauf verlassen, dass Zugriffe, Quellen und Verantwortlichkeiten sauber geregelt sind. So wird Wissen skalierbar nutzbar — nicht zufällig, sondern systematisch.

Der Nutzen ist direkt spürbar: geringere Suchzeiten, weniger Rückfragen, konsistentere Entscheidungen, schnellere Einarbeitung neuer Mitarbeitender und eine deutlich höhere Nutzbarkeit bestehender Wissensbestände. Gleichzeitig entsteht ein tragfähiges Fundament, um KI nicht nur punktuell, sondern strukturiert und sicher im Unternehmen einzusetzen.

Was wir anders machen

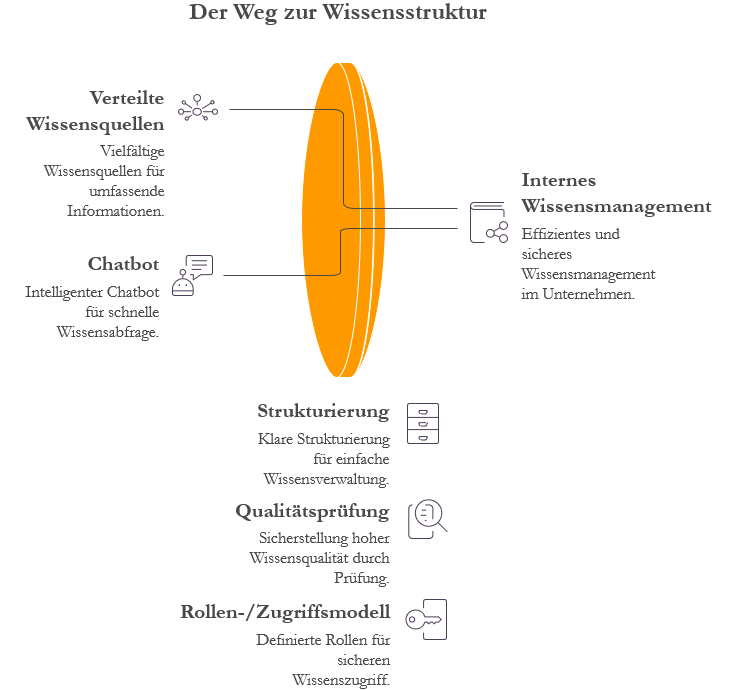

Wir betrachten LLMs und Chatbots nicht als isoliertes Tool, sondern als Teil einer belastbaren Wissensarchitektur. Deshalb starten wir nicht bei der Oberfläche, sondern bei der Frage, welche Informationen im Unternehmen überhaupt relevant sind, in welcher Qualität sie vorliegen, wer darauf zugreifen darf und wie Antworten nachvollziehbar und vertrauenswürdig werden.

Unser Fokus liegt dabei auf Nutzbarkeit im Alltag. Eine Lösung ist erst dann erfolgreich, wenn sie von Mitarbeitenden tatsächlich angenommen wird, wenn Antworten verständlich und verlässlich sind und wenn Fachbereiche das Gefühl haben, dass ihre Inhalte nicht in einer Black Box verschwinden. Deshalb verbinden wir Technologie, Wissensstruktur, Governance und Anwenderperspektive.

Das bedeutet auch: Wir denken Sicherheit und Skalierbarkeit von Anfang an mit. Statt unkontrollierter KI-Experimente schaffen wir einen Rahmen, in dem interne Wissenslösungen fachlich sauber, technisch sinnvoll und organisatorisch anschlussfähig aufgebaut werden können. So entsteht kein Demo-Use-Case, sondern ein echter Mehrwert für produktive Prozesse.

Unsere Leistungen im Überblick

Wir unterstützen Unternehmen dabei, aus vorhandenen Informationen eine nutzbare, sichere und strukturierte Wissenslösung zu entwickeln. Im Mittelpunkt steht nicht das Tool an sich, sondern das Ergebnis, das beim Kunden ankommt: ein klar beschriebenes Zielbild, eine priorisierte Anwendungslogik, ein belastbares Daten- und Zugriffsmodell sowie ein umsetzbarer Weg in die Praxis.

Zu Beginn konkretisieren wir den relevanten Einsatzbereich. Gemeinsam identifizieren wir Fragen, Suchmuster und Informationsbedarfe, bei denen ein interner Wissens-Chat, ein KI-gestützter Assistent oder eine LLM-basierte Wissensoberfläche echten Nutzen stiftet. Daraus entsteht ein klarer Use-Case-Zuschnitt statt einer unspezifischen „KI für alles“-Lösung.

Darauf aufbauend strukturieren wir die Wissensgrundlage. Wir erfassen relevante Quellen, bewerten deren Qualität und Aktualität und definieren, welche Inhalte für welche Nutzergruppen nutzbar gemacht werden sollen. So entsteht Transparenz darüber, welches Wissen überhaupt geeignet ist, in einer KI-gestützten Lösung verwendet zu werden.

Ein zentraler Baustein ist das Berechtigungs- und Zugriffsmodell. Gerade bei internem Wissen ist entscheidend, dass nicht jede Person alles sehen darf. Wir entwickeln mit Ihnen eine saubere Logik für Rollen, Freigaben und Zugriffsebenen, damit sensible Inhalte geschützt bleiben und gleichzeitig nutzbare Informationsräume entstehen.

Ebenso wichtig ist die Qualitätssicherung. Wir definieren, wie Quellen referenziert werden, wie Versionen gehandhabt werden, welche Freigabeprozesse sinnvoll sind und wie Antworten nachvollziehbar bleiben. Damit wird aus einer generischen KI-Anwendung eine belastbare Wissenslösung mit fachlichem Rückgrat.

Am Ende stehen keine abstrakten Konzepte, sondern konkrete Ergebnisse, mit denen Sie weiterarbeiten können. Je nach Zuschnitt liefern wir unter anderem:

- ein Use-Case-Design für internen Wissenszugriff mit typischen Fragestellungen, Zielgruppen und Anwendungsgrenzen

- eine strukturierte Quellen- und Wissenslandkarte, die relevante Dokumente, Systeme und Inhaltsverantwortliche sichtbar macht

- ein Daten- und Berechtigungsmodell, das Zugriff, Rollen und Schutzbedarfe abbildet

- ein Qualitätssicherungskonzept für Quellen, Versionen, Freigaben und Antwortnachvollziehbarkeit

- eine fachliche Lösungsarchitektur für LLM-/Chatbot-/RAG-nahe Wissenslösungen

- eine Umsetzungs-Roadmap mit priorisierten Schritten vom Pilot bis zur produktiven Nutzung

- auf Wunsch einen konkreten Beispiel-Output oder Prototypenrahmen, mit dem interne Stakeholder die Lösung greifbar bewerten können

Proof / Mini-Case / Beispieloutput

Ein mittelständisches Unternehmen wollte internes Wissen schneller verfügbar machen, ohne sensible Informationen unkontrolliert in frei nutzbare KI-Tools zu geben. Die Ausgangslage war typisch: Prozessdokumente lagen verteilt in mehreren Ablagen, Richtlinien waren nicht immer eindeutig versioniert, und viele Rückfragen liefen informell über einzelne Schlüsselpersonen. Das führte zu hoher Suchzeit, Medienbrüchen und Abhängigkeit von individuellem Erfahrungswissen.

Im Projekt wurde zunächst der konkrete Anwendungsrahmen geschärft: Welche Fragen treten regelmäßig auf, welche Inhalte sind besonders relevant und wo ist die Unsicherheit im Alltag am größten? Anschließend wurden zentrale Dokumentenquellen strukturiert, in Themenräume überführt und mit einer Berechtigungslogik verbunden. Ergänzend entstand ein Qualitätssicherungsrahmen, der festlegte, welche Dokumente als verlässliche Quellen dienen, wie Aktualität kenntlich gemacht wird und wie Antworten mit Quellenbezug dargestellt werden sollen.

Als Ergebnis lag kein „KI-Spielzeug“, sondern ein belastbarer Umsetzungsrahmen für einen internen Wissens-Chat vor — mit priorisierten Use Cases, definierter Datenbasis, klaren Zugriffsregeln und beispielhaften Antwortformaten. Für den Kunden besonders wertvoll war nicht nur die technische Richtung, sondern die neu gewonnene Transparenz darüber, welches Wissen wo liegt, wem es gehört und wie es künftig kontrolliert nutzbar gemacht werden kann.

Beispiel für Deliverables aus einem solchen Projekt:

- Use-Case-Steckbrief „Interner Wissens-Chat“

- Dokumenten- und Quelleninventur mit Relevanzbewertung

- Rollen- und Berechtigungsmatrix

- Qualitätskriterien für Antworten und Quellenreferenzen

- Roadmap für Pilotierung und Rollout

Typische Probleme und der konkrete Nutzen

Typische Ausgangslage im Unternehmen | Konkrete Auswirkung im Alltag | Zielbild / Kundennutzen |

Wissen liegt in vielen Ordnern und Tools verteilt | Hohe Suchzeiten, unnötige Rückfragen | Informationen schneller finden und gezielter nutzen |

Mitarbeitende erhalten unterschiedliche Antworten auf dieselbe Frage | Unsicherheit, Fehler, Abstimmungsaufwand | Einheitlichere und belastbarere Auskünfte |

Wissen steckt stark bei Einzelpersonen | Abhängigkeiten, Engpässe, schwierige Vertretung | Wissen breiter verfügbar und skalierbar machen |

Dokumente sind nicht sauber versioniert oder freigegeben | Veraltete Informationen im Umlauf | Klare Quellenlogik und bessere Nachvollziehbarkeit |

KI-Tools werden punktuell getestet, aber nicht kontrolliert eingebunden | Sicherheitsbedenken und geringe Akzeptanz | Strukturierte, sichere und verantwortbare Nutzung |

Kompakte Einordnung: Woraus eine gute interne Wissenslösung besteht

Baustein | Worum es geht | Warum es relevant ist |

Use-Case-Design | Klare Abgrenzung des Anwendungsfalls | Verhindert unscharfe Lösungen ohne echten Mehrwert |

Wissensbasis | Relevante Dokumente, Inhalte und Datenquellen | Nur gute Quellen führen zu guten Antworten |

Berechtigungen | Wer darf auf welche Inhalte zugreifen? | Schutz sensibler Informationen |

Qualitätslogik | Quellen, Freigaben, Versionen, Aktualität | Höheres Vertrauen in Antworten |

Nutzerführung | Verständliche Interaktion und alltagstaugliche Nutzung | Akzeptanz und Wirksamkeit in der Praxis |

Governance | Verantwortlichkeiten und Betriebsmodell | Nachhaltige Einführung statt Einzelinitiative |

Ist ein interner Chatbot auch dann sinnvoll, wenn unsere Dokumente noch nicht perfekt strukturiert sind?

Ja, aber nicht jedes Dokument sollte sofort in eine Wissenslösung übernommen werden. Entscheidend ist, zunächst die relevanten Quellen zu identifizieren, Qualitätsunterschiede sichtbar zu machen und eine sinnvolle Priorisierung vorzunehmen. Oft ist genau diese Transparenz schon ein großer Mehrwert des Projekts.

Brauchen wir dafür sofort eine große technische Plattform?

Nicht zwingend. In vielen Fällen ist es sinnvoller, zunächst den fachlichen Anwendungsfall, die Wissensquellen und die Governance sauber zu definieren, bevor technische Entscheidungen getroffen oder erweitert werden.

Wie stellen wir sicher, dass Mitarbeitende nur auf Inhalte zugreifen, die sie sehen dürfen?

Dafür wird ein Rollen- und Berechtigungsmodell entwickelt, das bestehende Zugriffskonzepte aufnimmt und für die Wissenslösung nutzbar macht. Gerade bei internen KI-Anwendungen ist dieser Punkt zentral.

Wie vermeiden wir falsche oder irreführende Antworten?

Nicht durch Hoffnung, sondern durch Systematik: mit klar definierten Quellen, Versionierung, Freigabelogik, Antwortgestaltung und nachvollziehbaren Referenzen. Eine gute Lösung macht sichtbar, worauf sich eine Antwort stützt.

Ist das nur für große Unternehmen relevant?

Nein. Gerade im Mittelstand entstehen oft große Hebel, weil Wissen stark personenabhängig ist und Suchaufwand in vielen Bereichen unnötig hoch bleibt. Der Mehrwert ergibt sich nicht aus der Unternehmensgröße, sondern aus dem Bedarf an schnellerem, verlässlicherem Wissenszugriff.

Was ist der Unterschied zwischen einem allgemeinen KI-Chat und einem internen Wissens-Chat?

Ein allgemeiner KI-Chat arbeitet meist ohne klar abgegrenzte interne Wissensbasis. Ein interner Wissens-Chat dagegen bezieht sich auf definierte Quellen, Rollen, Regeln und Qualitätsanforderungen innerhalb des Unternehmens.

Welche Bereiche profitieren besonders?

Typisch sind Einkauf, HR, IT, Service, Vertrieb, Qualitätsmanagement, interne Richtlinienkommunikation und Onboarding. Überall dort, wo Informationen häufig gesucht, erklärt oder wiederholt beantwortet werden, entstehen spürbare Effekte.